Als neues Technology Partner Mitglied in der VAST Cosmos Community integriert Mirantis über k0rdent AI eine standardisierte Schnittstelle für VAST Data. Diese Lösung eliminiert zeitaufwendige Einzelanpassungen und ermöglicht Operatoren von Neoclouds eine einfache Zusammenführung heterogener KI-Infrastrukturkomponenten. Die automatisierten Abläufe erhöhen die Effizienz im Multi-Vendor-Betrieb, maximieren die GPU-Auslastung und steigern den Datendurchsatz. Dadurch lassen sich KI-Services mit hoher Performance schneller bereitstellen und die Gesamtkosten Infrastruktur senken. bei gleichbleibender Zuverlässigkeit und Skalierbarkeit.

Inhaltsverzeichnis: Das erwartet Sie in diesem Artikel

Standardisierter Integrationspfad für KI-Infrastrukturen dank Mirantis und VAST Data

Die Partnerschaft von Mirantis und VAST Data verknüpft die Kubernetes-native Plattform k0rdent AI mit dem VAST Cosmos Ökosystem, um einen standardisierten Integrationspfad für Neoclouds bereitzustellen. Anwender profitieren von wiederholbaren Deployment-Mustern, automatisierter Orchestrierung heterogener GPU-Infrastruktur und nahtloser Einbindung dynamischer Datendienste. So sinkt der Aufwand individueller Anpassungen deutlich, während Hochleistungs-Inferenzdienste schneller skaliert und GPU-Ressourcen effizienter genutzt werden. Zudem gewährleistet die Lösung hohe Vorhersehbarkeit und Investitionssicherheit. Skalierbare Automatisierung vereinfacht komplexe Umgebungen sehr nachhaltig.

Mirantis und VAST Data vereinfachen Integration in k0rdent AI

Die Kooperation von Mirantis und VAST Data etabliert eine standardisierte Schnittstelle, um das VAST KI-Betriebssystem effizient in k0rdent AI zu integrieren. Wiederholbare Verfahren ersetzen aufwändige Einzelanpassungen und vereinfachen den Integrationsprozess erheblich. Die offene Struktur von k0rdent AI erlaubt die modulare Zusammenstellung von Compute-, Netzwerk- und Storage-Ressourcen, während VAST Data leistungsstarke Datendienste beisteuert. So profitieren Betreiber von einer konsistenten Infrastruktur, ausgelegten Workflows und optimiertem Datendurchsatz für KI-Anwendungen und massiv verkürzten Betriebszeiten.

Standardisierte Integration eliminiert zeitintensiven Aufwand für schnelleres Neocloud KI-Deployment

Nach Ansicht von Kevin Kamel, Vice President of Product Management bei Mirantis, stehen Betreiber von Neoclouds unter enormem Druck, ihre GPU-Infrastruktur optimal auszulasten und Auslastungslücken zu vermeiden. Die Zusammenarbeit eliminiert zeitaufwendige Integrationsprozesse, indem vorgefertigte Komponenten und automatisierte Abläufe genutzt werden. Damit lässt sich der Alltagsbetrieb deutlich verschlanken, Skalierungen erfolgen schneller und Fachteams können sich stärker auf die erfolgreiche Umsetzung datenintensiver KI-Workloads konzentrieren, wodurch Zeitersparnis, Effizienzsteigerung und Ressourcenauslastung maximiert werden nachhaltig.

k0rdent AI und VAST Data eliminieren Daten und Storage-Engpässe

Viele moderne KI-Infrastrukturen leiden unter Verzögerungen und Engpässen zwischen Speicherlösungen und Datenpipelines, was zu ungenutzten GPU-Kapazitäten und ineffizientem Ressourceneinsatz führt. VAST Data begegnet dieser Herausforderung mit einem durchgängigen Datendienst-Framework, das nahtlos alle Phasen vom Datenmanagement und Training bis zur Inferenz und agentenbasierten KI-Bereitstellung orchestriert. In Kombination mit k0rdent AI entsteht ein homogener und hochperformanter Technologie-Stack, der Durchsatz maximiert und GPU-Auslastung kontinuierlich optimiert. Er ermöglicht schnelle Skalierung, Stabilität und kosteneffizienten Betrieb.

Validierte Bausteine ersetzen individuelle Stacks für effiziente sichere GPU-Umgebungsarchitektur

Beide Unternehmen tragen aktiv zu branchenweiten Ökosystem-Initiativen bei, indem sie NVIDIA-geführte Referenzarchitekturen für großdimensionierte GPU-Infrastrukturen mitgestalten. Diese vordefinierten Designvorlagen beschreiben detailliert das optimale Zusammenspiel von Recheninstanzen, Netzwerkverbindungen und Speicherlösungen. Durch den Einsatz geprüfter, modularer Bausteine anstelle individueller Sonderentwicklungen erzielen Betreiber verlässliche Performance, verbesserte Sicherheit und planbare Betriebskosten. Der modulare Aufbau vereinfacht Updates, erhöht die Flexibilität und ermöglicht eine zukunftssichere Skalierung bei komplexen KI-Anwendungen, und reduziert zugleich Entwicklungsaufwand und Integrationsrisiken erheblich.

Wiederholbare Deployment-Muster minimieren manuellen Aufwand für Kubernetes-basierte GPU-Clouds effizient

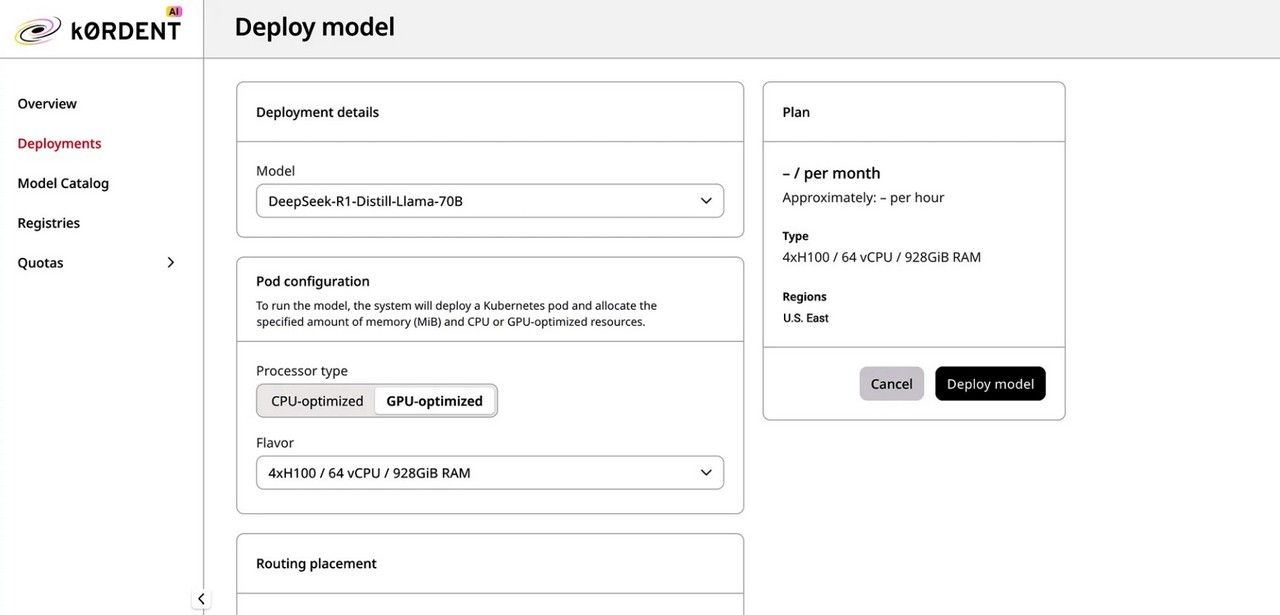

Kubernetes-basierte Neocloud-Plattformen, die auf GPU-optimierte KI-Workloads abzielen, etablieren mit k0rdent automatisierte Abläufe. Wiederverwendbare Deployment-Vorlagen minimieren manuelle Konfigurationen und gewährleisten konsistente Infrastruktur-Layouts. Betreiber steuern Ressourcenpools zentralisiert, wodurch die Bereitstellung neuer KI-Services in wenigen Schritten erfolgt. Die native Automatisierung orchestriert GPU-Operationen dynamisch und maximiert die Nutzungsrate vorhandener Beschleuniger. Dieses methodische Vorgehen senkt Betriebskosten, verkürzt Time-to-Market und skaliert zuverlässig selbst anspruchsvolle KI-Umgebungen. Fehleranfällige Handkonfiguration entfällt vollständig. Änderungsprozesse werden versionsgesteuert dokumentiert. Transparenz erhöht Effizienz.

Standardisierte Integration reduziert Komplexität und beschleunigt KI-Workflow-Bereitstellung in Neoclouds

Durch die Partnerschaft von Mirantis und VAST Data entsteht eine standardisierte Pipeline, die Neoclouds bei der Einrichtung komplexer Multi-Vendor-KI-Plattformen entlastet und den Integrationsaufwand drastisch senkt. Kubernetes-native Automatisierung in k0rdent AI und das VAST Datendienst-Framework garantieren eine optimale Auslastung von GPU-Clusters, während validierte Referenzarchitekturen konsistente Leistung und Skalierbarkeit sicherstellen. Engpässe in Storage und Datenverarbeitung werden beseitigt, sodass Unternehmen KI-Dienste schneller und kosteneffizient einführen können und gleichzeitig Ressourcennutzung sowie Betriebskosten deutlich optimiert.